![Verloren unter 100 Freunden]()

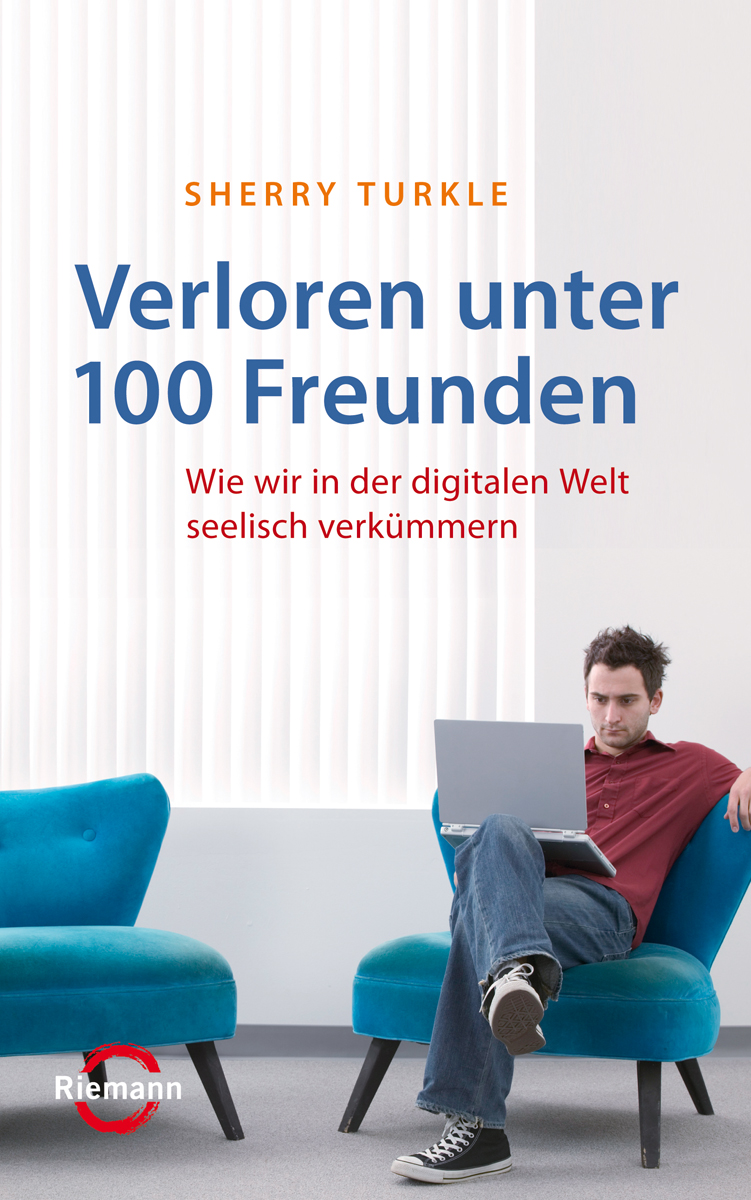

Verloren unter 100 Freunden

auszuwählen und zu testen. Die Bedeutung des Begriffs Intelligenz wandelte sich, als die Wissenschaft der künstlichen Intelligenz deklarierte, dass Computer sie besitzen könnten. Die Bedeutung des Begriffs Gedächtnis wandelte sich, als daraus etwas wurde, was Computer verwendeten. Und jetzt geschieht das Gleiche mit »Vertrauen«, nachdem es sich nun um etwas handelt, dessen Roboter wert sein können. Aber einige der Kinder fürchten, dass ein vertrauenswürdiger, weil verlässlicher Roboter dennoch kein perfekter Babysitter sein könnte, weil es ihm an Herz mangele. So sagt Bridget, sie könnte einen Roboterbabysitter liebhaben, falls er seine Aufgabe gut erledige, aber sie bezweifle, dass dies möglich sei. Sie beschreibt, was geschehen könnte, falls sie sich in Obhut eines Roboters das Knie aufschlüge: »Er würde einfach sagen [sie imitiert eine Roboterstimme]: ›Okay, was tue ich jetzt, ein Pflaster holen und es aufkleben, das ist alles. Das ist meine Aufgabe, ein Pflaster holen und es aufkleben …‹ [die Roboterstimme verstummt]. Aber um jemanden liebzuhaben, braucht man einen Körper und ein Herz. Diese Computer haben eigentlich kein Herz. Sie sind nur ein Gehirn … Ein Roboter kann beschädigt werden, aber er würde es nicht richtig spüren. Er würde sich einfach abschalten. Wenn er beschädigt ist, sagt der Roboter: ›Richtig, okay, ich bin beschädigt, ich schalte mich jetzt ab.‹«

Während Bridget erzählt, schaudert es mich. Dieses »Abschalten« ist natürlich das Verhalten des My Real Babys, das sich abschaltet, wenn man es grob behandelt. Bridget zieht dieses Detail als Grund dafür heran, warum ein Roboter keine Empathie haben kann. Wie einfach es doch wäre, was für eine kleine technische Sache, Robotern »vorgetäuschte Empathie« einzuverleiben. Ziemlich beklommen frage ich Bridget: »Also würde es für dich einen Unterschied ausmachen, wenn ein Roboter zeigen würde, dass er

Schmerz verspürt?« Sie antwortet ohne zu zögern: »Oh ja, aber diese Roboter gehen einfach aus, wenn sie sich etwas getan haben.« Aus meiner Perspektive ist die Ursache für die fehlende Roboter-»Empathie«, dass Roboter nicht Teil des menschlichen Lebenszyklus sind, dass sie nicht das erleben, was Menschen erleben. Aber darum geht es Bridget nicht. Für sie wäre ein Roboter ein geeigneter Gefährte, wenn er ein Schmerzempfinden vortäuschen könnte. Das ist der Behaviorismus in der Stunde des Roboters.

In Miss Grants Klassenzimmer gibt es kaum Sentimentalitäten. Vielmehr betrachtet einer ihrer Schüler Menschen als potentiell hinderlich für Beziehungen mit Robotern. »Wenn man sich schon an seinen Babysitter gewöhnt hat, ist man nicht mehr fähig, sich auf einen Roboter einzulassen.« Und das könnte schade sein. Denn der menschliche Babysitter ist nicht unbedingt die bessere Wahl, er war einfach zuerst da. Der Mangel an kindlicher Sentimentalität bedeutet nicht, dass für Kinder der Roboter immer an erster Stelle kommt. Nach einem langen Gespräch über Roboterbabysitter stellt Octavio sich zwar vor, dass man einen Roboter so programmieren könnte, dass er sowohl mit ihm spielt und ihm »Hähnchen oder Nudeln kocht, so wie es sich für ein anständiges Abendessen gehört«. Aber Bridget tut Octavios »Unsinn« ab. »Ein Mensch würde doch völlig ausreichen.« Jude pflichtet ihr bei: »Welchen Sinn hat es, für tausende von Dollar einen Roboter zu kaufen, wenn man einfach den Babysitter für zwanzig Dollar die Stunde behalten könnte?«

Haben wir keine Menschen für diese Jobs?

Kinder sprechen liebevoll über ihre Großeltern, deren Pflege oft für Spannungen in der Familie sorgt. Kinder verspüren ein Verantwortungsgefühl, und sie möchten, dass ihre Eltern auch Verantwortung

übernehmen. Und doch sehen Kinder, wie ihre Eltern sich damit schwertun. Könnten Roboter diese Aufgabe übernehmen?

Einigen Kinder gefällt die Idee, dass Maschinen den Großeltern in praktischen Dingen helfen könnten. Sie sprechen von einem Roboter, »der meiner Oma mitten in der Nacht Wasser ans Bett bringt«, »der auf meine Oma aufpasst, während sie schläft« und der mit »Notfall-Arzneien« ausgestattet ist. Diese Roboter könnten verlässlicher sein als Menschen – zum Beispiel würden sie keinen Schlaf benötigen –, und sie könnten es den Großeltern ermöglichen weiterhin zu Hause zu wohnen.

Andere Kinder gehen noch weiter: Sie denken daran, ihren Großeltern einen Robotergefährten gegen die

Weitere Kostenlose Bücher